由中国人工智能学会(CAAI)主办,合肥工业大学承办,CAAI因果与不确定性人工智能专委会、安徽省人工智能学会因果与不确定性专委会协办的CAAI因果与不确定性人工智能专委会2023年度学术沙龙于2023年11月11日在合肥举行。

该系列学术沙龙自2012年起,由原中国科协副主席张勤教授(中国人工智能学会因果与不确定性人工智能专委会主任、国际核能院院士、清华大学核研院和计算机系双聘教授)发起,每年举办一次,旨在充分发挥学术交流作为原始创新源头的作用,弘扬“敢于创新、勇于竞争和宽容失败的精神”,倡导自由探究,鼓励学术争鸣,为科学家在学术思想萌芽时期尚未获得主流认可的观点、理论以及灵感提供交流平台,先后两次纳入中国科协“新观点新学说”学术沙龙。本次沙龙已是该系列学术活动的第十二届。

沙龙合影

本次沙龙参会的有来自清华大学、北京大学、合肥工业大学、中国科学技术大学、武汉大学、北京航空航天大学、东南大学、吉林大学、北京工业大学、中国传媒大学、北京化工大学、合肥师范学院、南昌工程学院、安徽科技学院等单位30余位在不确定性人工智能领域有深入研究的专家和学者。

专委会主任、清华大学张勤教授代表专委会进行了开幕致辞。张勤教授讲到,在专委会成立的十多年里,各位专家对于充满挑战性的不确定性人工智能领域展开了多元化的研究探索。今天,这种探索的价值更加凸显,因为它能够填补当前主流深度学习方法的某些短板。合肥工业大学计算机与信息学院、软件学院党委书记年永琪致辞欢迎各位专家的到会,感谢大家对本次专委会学术沙龙活动的支持。

张勤教授致开幕词

年永琪书记致欢迎词

上午的沙龙报告中,清华大学孙茂松教授以《生成式人工智能:思考与挑战》为题深入剖析了自然语言大模型的核心逻辑和基础架构。他详细介绍了这类大模型的特性和优势,对大模型的举一反三能力进行了探讨,并对国内外的大模型研究进展进行了精炼而深入的比较分析。报告指出了目前大模型研究所面临的挑战问题,为我们进一步深化大模型研究提供了宝贵的指导和启示。

孙茂松教授作报告《生成式人工智能:思考与挑战》

清华大学张勤教授以《DUCG的最新进展和对人工智能治理倡议的思考》为题,展示了DUCG研究在各地区、各层级医疗机构的临床应用情况,该技术在精准缩短临床诊断路径、提升医疗服务水平和质量方面已经取得了显著效果。报告还介绍了DUCG在不确定性因果关系表达和推理机制中的核心思想。围绕习总书记在“一带一路”峰会上提出的《全球人工智能治理倡议》,探讨了人工智能技术所应具备的安全性、可靠性、可控性、公平性、可解释、可预测、可审核、可监督、可追溯、可信赖等特性及其实现方法,并认为基于因果关系的人工智能最能符合总书记提出的《全球人工智能治理》倡议。

张勤教授作报告《DUCG的最新进展和对人工智能治理倡议的思考》

张勤教授作报告《DUCG的最新进展和对人工智能治理倡议的思考》

山西大学曹付元教授作了题为《基于样本稳定性的机器学习方法研究》的报告,从概念模糊性和贝叶斯错误率角度给出了样本稳定性定义,建立了同质聚簇与稳定样本、弱稳定样本和不稳定样本的关系,并针对分类模型的评估标准、提升模型的泛化能力等问题提出了一系列新思路和解决方案。

曹付元教授作报告《基于样本稳定性的机器学习方法研究》

南昌工程学院车金星教授以《面向超短期风电不确定性特征的 K-前向邻居稀疏动态加权概率预测研究》为题,结合水利风电领域中实际应用所面临的随机波动和不确定性的问题,利用概率预测集成模型给出创新解决方案,该方案不仅提高了预测的精度,也增强了预测的稳定性。

车金星教授作报告《面向超短期风电不确定性特征的 K-前向邻居

稀疏动态加权概率预测研究》

下午,武汉大学叶茫教授进行了题为《不确定性模态下的行人重识别》的研究分享,结合人工智能不确定性问题的四个方面——环境的不确定性、数据的不确定性、模型的不确定性以及决策的不确定性,详细介绍了利用不确定性人工智能技术方法进行行人重识别的最新研究进展,并指出这项技术在城市安全、城市管理、零售与商业以及医疗等领域的实际应用潜力。

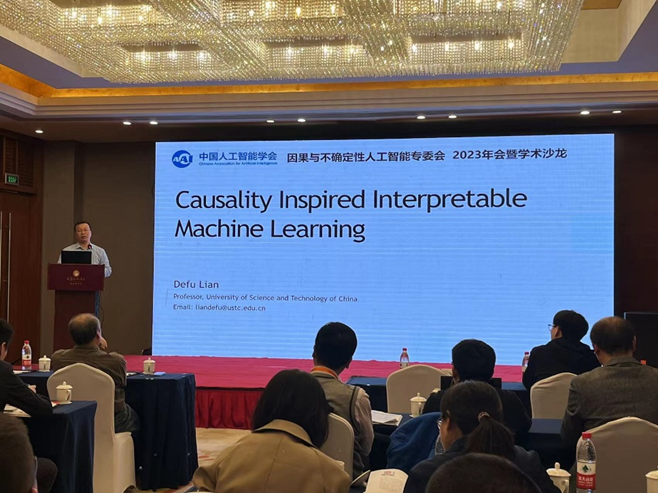

中国科学技术大学连德富教授以《Causality Inspired Interpretable Machine Learning》为题进行了分享,深入探讨了模型决策过程和决策函数的可解释性,对目前经典的可解释性方法进行了深度分析和思考,并从因果关系的视角,提出了一套可解释性应用方案,旨在解决在将因果推断应用到可解释性模型过程中所面临的挑战。

连德富教授作报告《Causality Inspired Interpretable Machine Learning》

连德富教授作报告《Causality Inspired Interpretable Machine Learning》

合肥工业大学吴乐教授带来关于《人在回路的个性化推荐公平性研究》的研究分享,深入剖析了决策过程中信息偏差的放大效应和学习模型的公平性问题,针对个性化推荐系统中的公平性问题进行了深度探讨和研究工作分享,为相关研究提供了新的视角和思考方向。

北京工业大学刘金铎博士作报告《基于因果生成对抗网络的脑效应连接学习方法》,指出尽管基于深度学习的脑网络学习和分类方法在性能上表现出色,但其模型的复杂性和不透明性可能会影响其在实际场景中的应用。报告详细介绍了其利用因果生成网络对脑效应连接和动态脑效应连接学习任务的新探索和研究工作。

刘金铎博士作报告《基于因果生成对抗网络的脑效应连接学习方法》(俞奎教授主持)

刘金铎博士作报告《基于因果生成对抗网络的脑效应连接学习方法》(俞奎教授主持)

沙龙现场图一

沙龙现场图一

沙龙现场图二

沙龙现场图二

本场学术沙龙氛围良好,与会师生与专家就报告内容进行了热烈的交流互动。沙龙结束后,因果与不确定性人工智能专委会召开专委会工作讨论会,通过了以专委会的名义参与制定“智能全科临床辅助诊断系统团体技术标准”事项、审议并接纳了十名新委员,这些新的学者的加入将为专委会的未来发展注入新的活力。

张勤教授主持专委会工作会议

本文由CAAI因果与不确定性人工智能专委会供稿

人划线